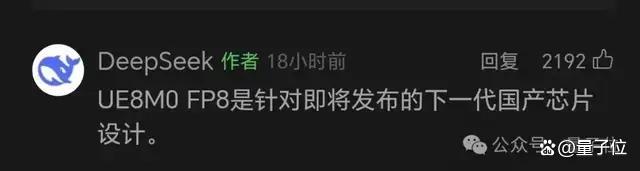

DeepSeek提到的FP8到底是啥 引发AI圈热议!DeepSeek V3.1发布后,一则官方留言在AI圈引起轰动。短短不到20个字的留言中提到新的架构和下一代国产芯片,信息量巨大。受此影响,国产芯片企业的股价纷纷上涨,例如寒武纪早盘盘中大涨近14%,总市值跃居科创板头名。半导体ETF也在半天内大涨5.89%。

许多人对UE8M0 FP8这一概念感到困惑。UE8M0 FP8可以拆分为两部分解释。UE8M0是MXFP8路径中的“缩放因子”,而MXFP8是Open Compute Project在2023年发布的8 bit微缩块格式。Open Compute Project是一个由Facebook(现Meta)、英特尔、Rackspace等发起的开源硬件协作计划,旨在通过共享数据中心及服务器设计推动行业效率提升。其成员包括微软、谷歌、亚马逊、AMD、英伟达以及国内的阿里、腾讯、百度等公司。

MXFP8基于FP8建立,将常规浮点格式压缩到8 bit。MXFP8的核心思想是将张量切成固定长度的“块”,为每个块指定一个2的整数次幂作为“缩放因子”,然后将块内所有数值除以这个系数后再写成FP8。这种块级的缩放方式保留了8 bit位宽,同时扩展了可用动态范围。UE8M0中的U表示无符号,E和M分别代表指数位和尾数位分配到的bit数。UE8M0指8个bit全部分配给了指数位。

采用全指数表示缩放因子的方式有多个好处。首先,处理器在根据缩放因子复原数据时只需移动指数位,无需进行浮点乘法、规格化或舍入逻辑,缩短了时钟关键路径。此外,UE8M0的动态范围覆盖2^(−127)到2^128,为后续块缩放提供了充足空间。它还能解决单尺度FP8无法同时处理大/小值的问题,减少了信息损失。

UE8M0 FP8更适配“下一代国产芯片”。目前,大部分已量产的国产AI加速器仍使用FP16/BF16 + INT8计算通路,未集成完整的FP8乘加单元。但摩尔线程MUSA 3.1 GPU、芯原VIP9000 NPU等新款国产芯片已在宣传资料中列出“原生 FP8”或“Block FP8”支持,并与多家厂商联合验证UE8M0格式。虽然下一代国产芯片在HBM/LPPDDR带宽方面仍有差距,但UE8M0让一组32个FP8数据只追加8bit缩放引子,相比传统FP32节省75%流量,成为重要优化方向。

网友们猜测DeepSeek可能是在说哪家国产芯片。首批通过“DeepSeek大模型适配”的8家厂商中,寒武纪被看作“头号种子选手”,市场反应强烈。海光、沐曦、中昊芯英和摩尔线程等也被提及。华为昇腾虽然暂不支持原生FP8,但预计未来推出的910D可能会支持。这些国产芯片一旦支持UE8M0 FP8,意味着国产AI正走向软硬协同阶段,减少对国外算力的依赖。这将大幅提升国产芯片的性价比,使其更具竞争优势。DeepSeek通过改动精度格式,主动贴合国产芯片的最佳性能点,构建了一个统一的生态坐标系。