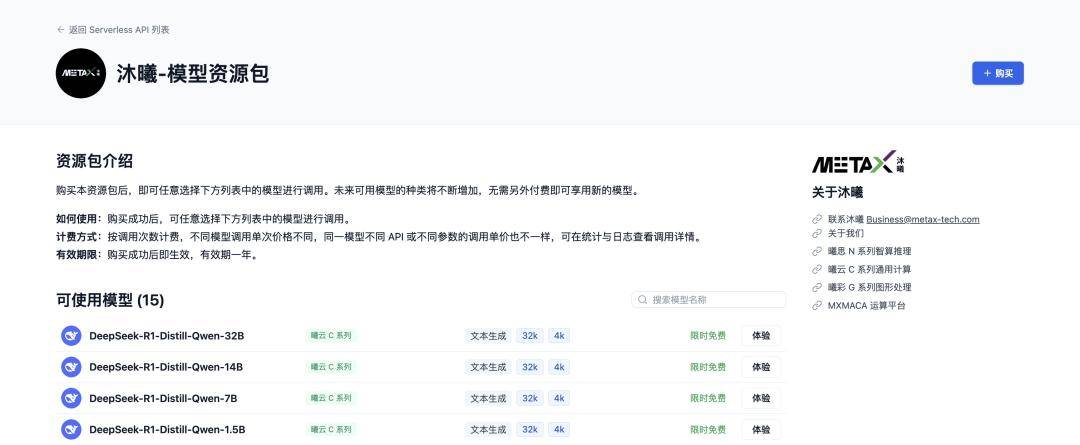

2 月 3 日消息,Gitee AI 昨日宣布上线 『DeepSeek』-R1-Distill-Qwen-1.5B、『DeepSeek』-R1-Distill-Qwen-7B、『DeepSeek』-R1-Distill-Qwen-14B、『DeepSeek』-R1-Distill-Qwen-32B四个较小尺寸的 『DeepSeek』 模型。更值得关注的是,本次上线的四个模型均部署在国产沐曦曦云 GPU 上。

与全尺寸 『DeepSeek』 模型相比,较小尺寸的 『DeepSeek』 蒸馏版本模型更适合企业内部实施部署,可以降低落地成本。

同时,这次 Deepseek R1 模型 + 沐曦曦云 GPU + Gitee AI 平台,更是实现了从『芯片』到平台,从算力到模型全国产研发。

注:『DeepSeek』 R1 是一款大型混合专家(MoE)模型,拥有 6710 亿个参数,支持 128000 个 Token 的大输入上下文长度。

本次部署在沐曦曦云 GPU 上的是四个 『DeepSeek』 R1 蒸馏模型,号称以更小参数量的资源占用,实现了性能与大参数模型“旗鼓相当”。

目前 Gitee AI 上的 『DeepSeek』-R1-Distill 系列模型现已面向全体开发者免费使用。