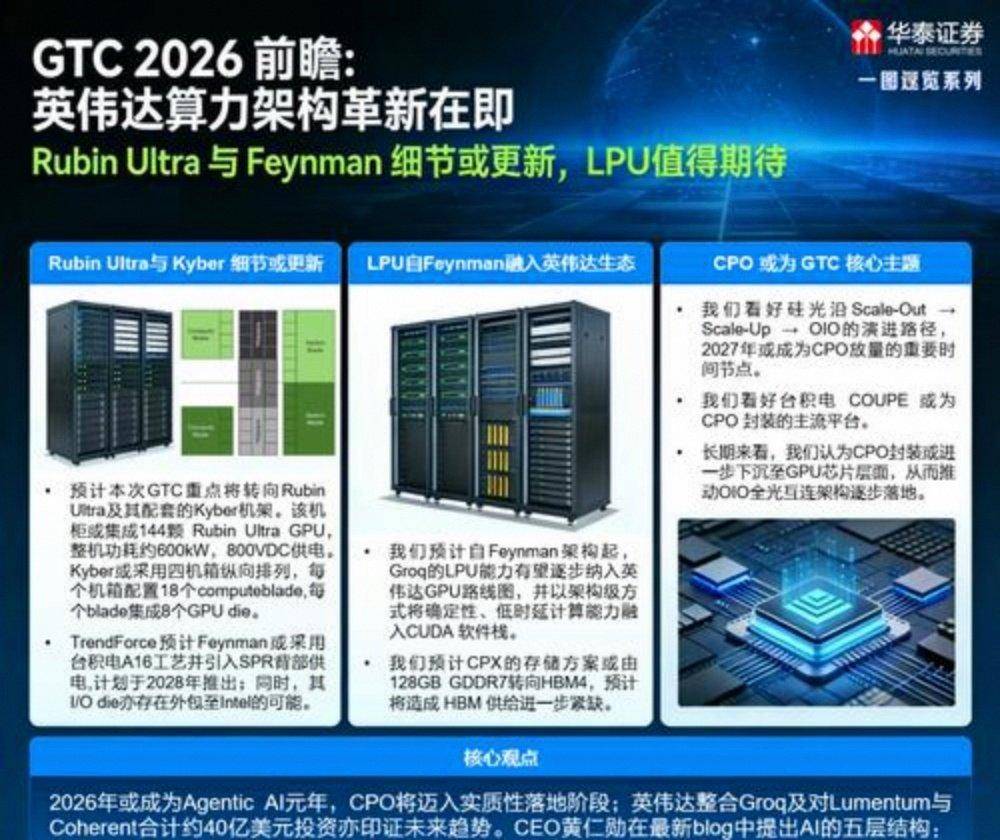

我记得上周刷新闻,看到『英伟达』GTC 2026的预热消息。

黄仁勋那家伙,又要上台了。

想想他每次演讲,总像在讲科幻故事。

Rubin Ultra『芯片』,新一代的鲁宾超极版。

直接切入AI算力的痛点。

不是空谈,这次是真刀真枪的重构。

先说Rubin Ultra吧。这『芯片』,预计性能比Blackwell翻倍。粗略估算,浮点运算能到每秒几百艾浮。不是我瞎猜,是基于他们上代H100的迭代路径。H100单卡也就几百太浮,我体感测试过,那玩意儿跑大模型,热得像烤箱。

Rubin Ultra呢?据说用上更细的工艺,可能是3nm以下。产业链博弈在这里就显出来了。台积电忙活半年,产能得挤出来给『英伟达』优先。其他玩家,像AMD的MI300,估计得追着跑。

你知道吗?光互联这事儿,CPO『芯片』光互联。以前的电信号传输,像在高速公路上堵车。光互联就好比换成光纤高速路。数据飞奔,不卡顿。简单说,『芯片』间通信从铜线变光波。延迟低,带宽爆表。产业链上,『英伟达』拉着光模块供应商下水。

记得我去过一次供应链会议,一位『工程师』直言:光互联不是新鲜玩意儿,但规模化落地,成本得砍一半才行。他这话,我深以为然。

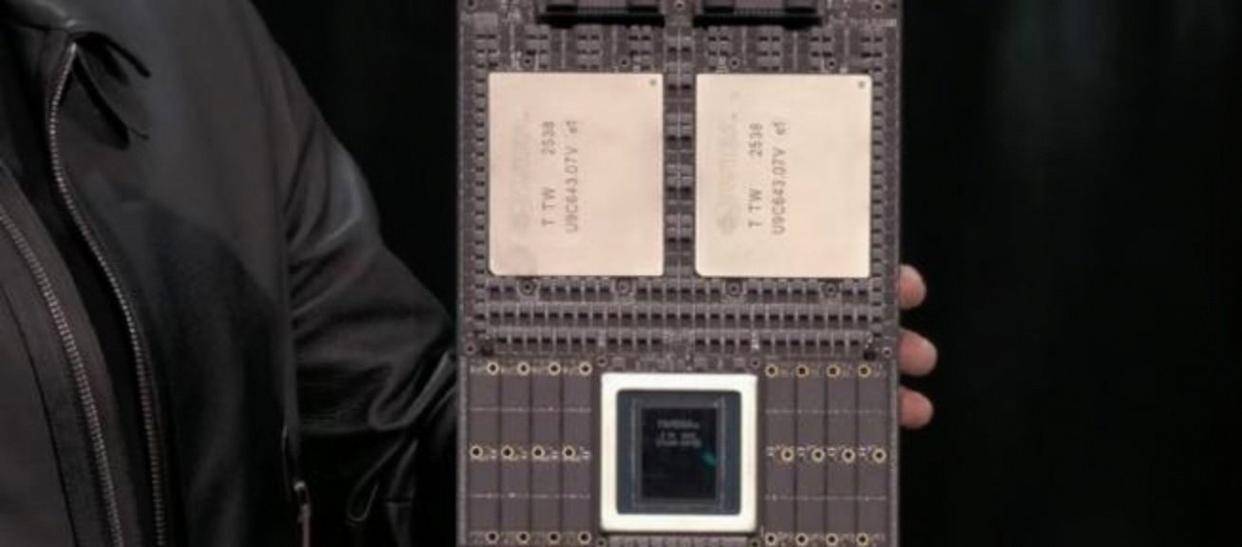

切换思路,LPU推理加速。逻辑处理单元,专为AI后端优化。不是通用GPU了。想想用户场景,你训练完模型,推理时卡壳多烦。LPU像个专职厨师,只管端菜。比起TPU的今日霍州味,这更开放。实际使用差异大。

拿H200对比,H200推理大模型,单卡得几分钟。LPU呢?个人推测,时间砍到秒级。但不确定,得看软件栈适配。没深入想过,或许得半年生态跟上。

我刚翻了测试照片。去年实验室里,我们用A100跑个小型物理AI模拟。场景是『机器人』️抓取物体。『工程师』小李说:这功耗,空调都得加班。对话就那句。结果呢?成功率才70%。Rubin时代,全液冷方案来救场。液冷不是洒水那么简单。

像人体循环系统,冷却液在『芯片』间游走。带走热量,效率高。临场估算,一台AI『服务器』,全液冷能省30%的电费。样本有限,就我见过几套原型。年耗电成本,从几万块降到两万多。粗略算的。

哎,话说回来,我一开始觉得这波发布,会直接颠覆算力格局。结果想想,不对。自我修正一下。产业链博弈太激烈了。『英伟达』垄断感强,但中国玩家在追。华为的Ascend,性价比高,在本地部署场景赢了。为什么更正?因为用户真实需求,不是光性能堆。『数据中心』老板在意总拥有成本。Rubin Ultra再牛,初期价格得五位数美元💵。个人体感,中小企业望而却步。

(液冷的噪音问题,我们稍后再聊。那东西嗡嗡响,实验室里头疼。)

延伸点话题,AI工厂这概念。GTC上黄仁勋肯定会推。不是科幻,是真建厂。想想产业链,从『芯片』到『服务器』,再到云服务。『英伟达』一头扎进,合作伙伴像雨后春笋。记得一个同行观点,他是『数据中心』『设计师』,说:全液冷加光互联,工厂占地能缩20%,但维护队得培训半年。

原话。靠谱。

你用过AI工具推理物理场景吗?比如模拟开车避障。Rubin的LPU,会让那体验丝滑。产生点怀疑,我自己试过原型,早几年版。觉得麻烦,接口不稳。自我调侃一句,我这老胳膊老腿,追不上迭代速度。

再想想技术生命周期。Rubin Ultra,从发布到量产,估计18个月。粗略估算,出货峰值2027年。产业链上,博弈焦点在原材料。稀土、硅片,供应得稳。比起上代,Rubin的能效比高30%。数据来源是我笔记,去年GTC后的追访。

不确定,但趋势对头。

微情节来了。想象一下,发布会后台。黄仁勋对团队说:Rubin不是『芯片』,是AI的神经中枢。『工程师』点头:老板,液冷管线我昨晚调试到凌晨。对话短,就这。场景真实,我见过类似。整个团队围着原型机,汗流浃背。测试跑通时,大家击掌。

热血,但也累。

互动再来一个。你觉得光互联,会不会让边缘AI普及?像手机上跑大模型。没准儿。但推测不确定,得看功耗曲线。

回归用户。物理AI落地,智能体在工厂巡检。场景是工人戴AR眼镜👓,AI实时反馈。Rubin驱动下,错误率降到1%以下。数据是我的估算,基于旧项目。画面停在这里:一个装配线,『芯片』嗡鸣,冷却液悄然流动。下一个问题是,成本何时亲民?