当ChatGPT还在和你进行“文字游戏”时,一个名为OpenClaw的工具已悄然推开新时代的门缝——它不止思考,更能行动。近日,这款个人AI代理工具从科技圈火遍全球,从被迫更名到引爆话题,其背后不仅是技术的跃进,更是一场关于未来人机关系、开发模式与安全边界的深度博弈。

一、从“教你做”到“帮你做”:AI终于“长出了手”

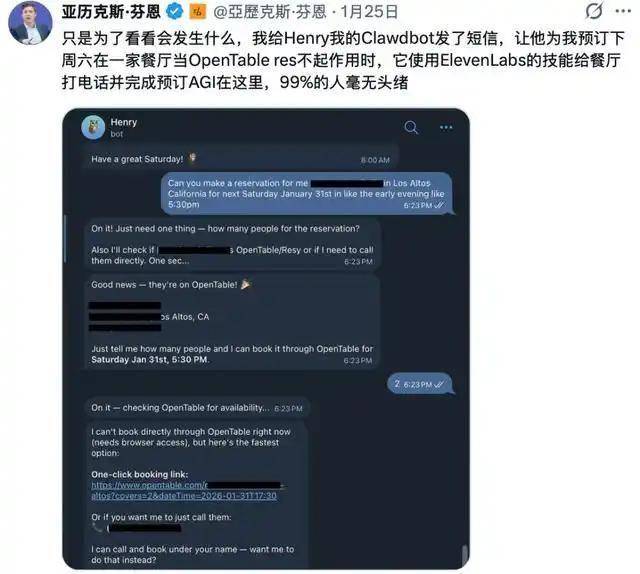

与以往仅能回答、建议的聊天『机器人』️不同,OpenClaw的核心突破在于执行力。用户通过WhatsApp、Telegram等日常通讯软件发送指令,它便能直接操作电脑完成文件整理、信息处理等任务。这看似简单的跨越,实则是AI从“参谋”到“员工”的角色质变。

其技术内核,是将大型语言模型(LLM)与系统工具深度结合,赋予AI自主调用软件、执行流程的能力。它拥有永久记忆,可基于历史交互持续优化行动——这已接近AGI(通用人工智能)的初级形态。正如网友所说:“以前AI告诉你步骤,现在AI直接帮你走完全程。”

工具的意义从来不在工具本身,而在它如何重塑普通人的生产力。OpenClaw的出现,让每个普通用户都可能拥有24小时在线的“数字雇员”,人机协作的门槛被极大地降低。

二、个人挑战巨头:一场“车库革命”的序幕

OpenClaw的出身颇值得玩味:它源于个人开发者,因被AI巨头Anthropic指控商标™️相似而被迫更名为“OpenClaw”,其中“Open”表明其开源属性。这场“小虾米对上大鲸鱼”的插曲,恰恰成为其爆火的助推剂。

它揭示了一个趋势:在强大基础模型日益普及的今天,一个深刻理解“模型语言”的个体开发者,其创新速度与产品灵活性,已可能挑战传统软件巨头的开发模式。个人开发者能够快速试错、贴近场景、专注解决具体问题,而这往往是臃肿的大公司难以做到的。

然而,硬币🪙的另一面是风险。个人项目在资金、安全合规性、长期维护上的脆弱性不容忽视。当AI能直接操作用户系统,一旦被恶意利用或出现失控,后果将远超一次简单的聊天泄露。

三、“工具自由”与“责任铁笼”的必答题

OpenClaw的走红,将两个尖锐问题推至台前:我们究竟需要多“强大”的AI工具?又该由谁来为它的行动负责?

一方面,人们渴望更高自主性的AI,以从繁琐劳动中解放。另一方面,当AI能跨应用执行指令,其行动边界变得模糊。它是否会无意间删除关键文件?是否会执行带有偏见的指令?其决策过程是否透明可审计?这些已非技术遐想,而是迫在眉睫的治理考题。

同时,开源模式虽促进了创新与普惠,但也可能降低恶意使用的门槛。如何在鼓励创新与筑牢安全防线之间取得平衡,将成为全球监管者与开源社区共同面临的严峻挑战。

写在最后

OpenClaw的火爆,不是一个孤立的技术新闻,而是一个强烈的时代信号。它标志着AI正从“对话的玩具”迈向“行动的伙伴”,个人开发者正借助大模型浪潮释放前所未有的创造力。

然而,技术进步的车轮越快,安全与伦理的护栏就越需要提前筑牢。我们拥抱的是一个能“动手”的智能新时代,但绝不能是失去控制、代价未知的冒险时代。未来的竞争,不仅是技术的赛跑,更是治理智慧与人类责任的较量。在欢呼“一句话就能执行任务”的魔力时,我们更须清醒地问自己:我们,真的准备好了吗?